在训练模型的时候,我们需要损失函数一直训练到0吗?显然不用。一般来说,我们是用训练集来训练模型,但希望的是验证集的损失越小越好,而正常来说训练集的损失降低到一定值后,验证集的损失就会开始上升(即过拟合),因此没必要把训练集的损失降低到0。 为了对抗这种过拟合现象,提高模型的测试集表现(即泛化能力),一种很自然的想法是提前终止(early stopping),也就是当观测到模型的验证集表现不降反升时,果断停止训练。这也是如今大模型跑小数据时的最常用做法。 既然如此,在模型训练loss已经到达某个阈值之后,我们可不可以做点别的事情来继续提升模型的测试集性能呢?一篇发表于机器学习顶会ICML2020上的论文《Do We Need Zero Training Loss After Achieving Zero Training Error?》[1]回答了这个问题。 不过这篇论文的回答也仅局限在“是什么”这个层面上,并没很好地描述“为什么”,另外看了知乎上kid丶[2]大佬的解读,也没找到自己想要的答案。因此自己分析了一下,记录在此。 论文提供的解决方案非常简单,假设原来的损失函数是,现在改为:

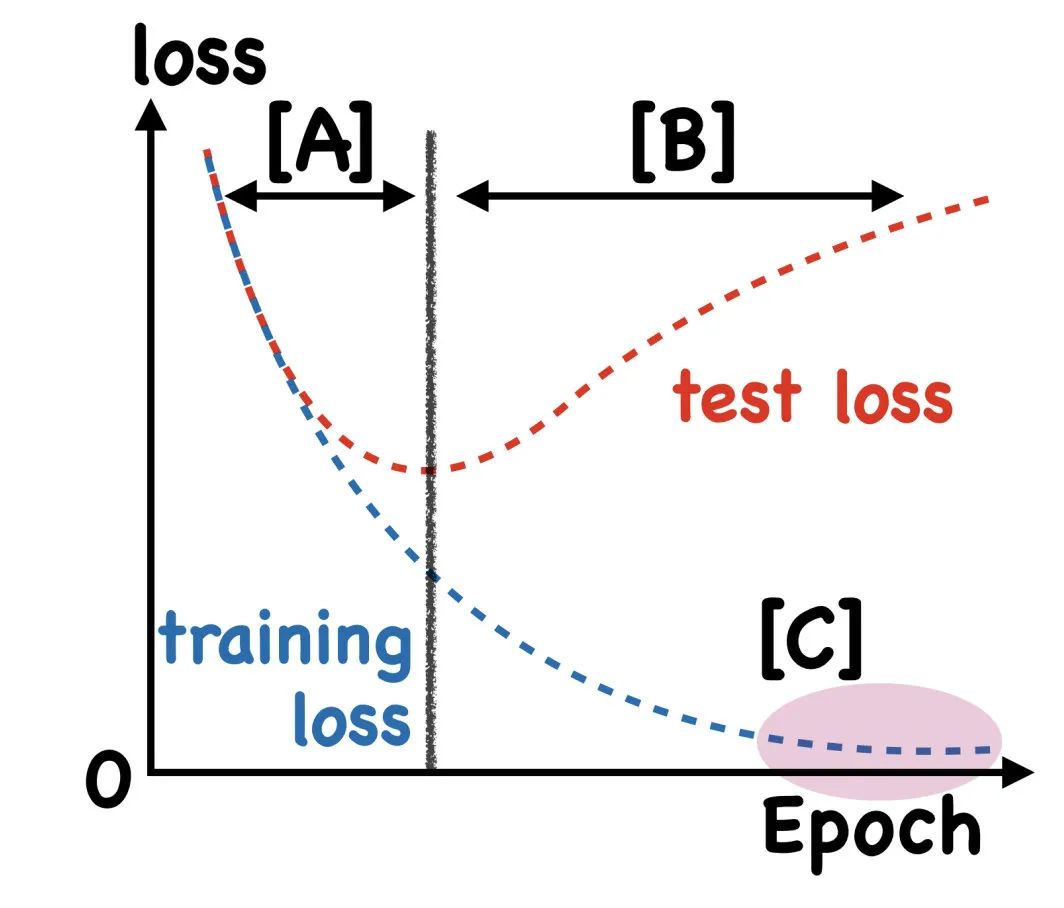

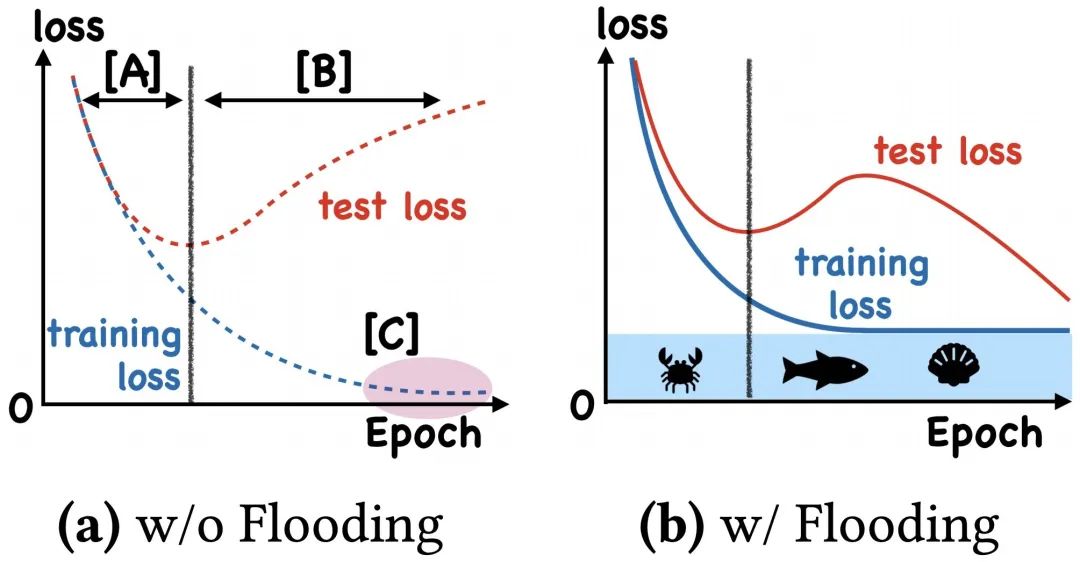

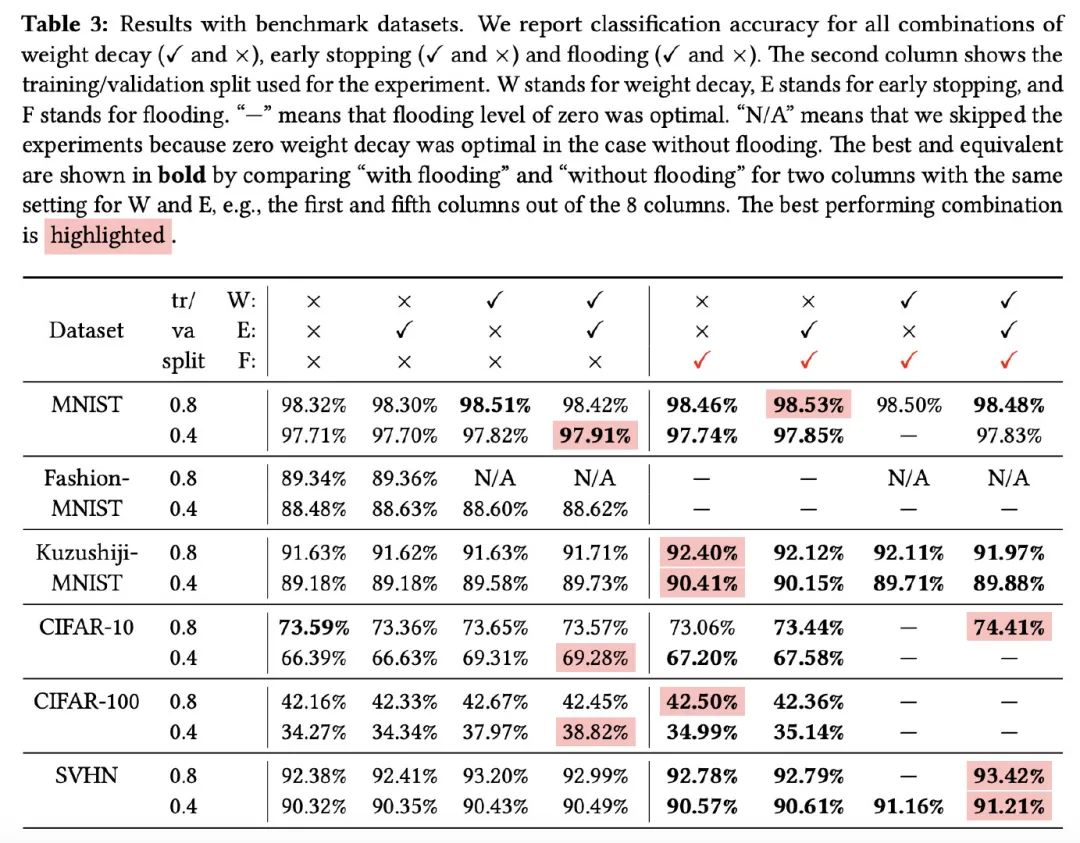

其中是预先设定的阈值。当时,这时候就是执行普通的梯度下降;而时,注意到损失函数变号了,所以这时候是梯度上升。因此,总的来说就是以为阈值,低于阈值时反而希望损失函数变大。论文把这个改动称为“Flooding”。 这样做有什么效果呢?论文显示,训练集的损失函数经过这样处理后,验证集的损失能出现“二次下降(Double Descent)”,如下图。简单来说就是最终的验证集效果可能更好些。 左图:不加Flooding的训练示意图;右图:加了Flooding的训练示意图 从上图可以看出来这个方法的理想很丰满,那么实际表现如何呢? 作者这里在MNIST、CIFAR等众多CV领域的benchmark上进行了实验,且如下图所示 图中中间一栏是没有加flooding的结果(early stopping和weight decay的四种排列组合),右边一栏是加了flooding的结果(四种排列组合的基础上都加上flooding)。可以看到加了flooding后,大部分情况下模型都能比之前有更好的测试集表现。 如何解释这个方法的有效性呢?可以想象,当损失函数达到之后,训练流程大概就是在交替执行梯度下降和梯度上升。直观想的话,感觉一步上升一步下降,似乎刚好抵消了。事实真的如此吗?我们来算一下看看。假设先下降一步后上升一步,学习率为,那么: 我们有 (滑动查看完整公式) 近似那一步是使用了泰勒展式对损失函数进行近似展开,最终的结果就是相当于损失函数为梯度惩罚、学习率为的梯度下降。更妙的是,改为“先上升再下降”,其表达式依然是一样的(这不禁让我想起“先升价10%再降价10%”和“先降价10%再升价10%”的故事)。因此,平均而言,Flooding对损失函数的改动,相当于在保证了损失函数足够小之后去最小化,也就是推动参数往更平稳的区域走,这通常能提供提高泛化性能(更好地抵抗扰动),因此一定程度上就能解释Flooding其作用的原因了。 本质上来讲,这跟往参数里边加入随机扰动、对抗训练等也没什么差别,只不过这里是保证了损失足够小后再加扰动。读者可以参考《泛化性乱弹:从随机噪声、梯度惩罚到虚拟对抗训练》[3]了解相关内容,也可以参考“圣经”《深度学习》第二部分第七章的“正则化”一节。 虽然这个方法看起来还挺work,但是不能忽视的一个细节是,作者在做上面表格里的每组flooding的实验时,都对flooding的超参b调节了20组(从0.01~0.20),如下 这在数据规模很小时实验代价还好,但单次实验代价较高时,可能就不那么实用了。 有心使用这个方法的读者可能会纠结于的选择或调超参的实验代价,不过笔者倒是有另外一个脑洞:无非就是决定什么时候开始交替训练罢了,如果从一开始就用不同的学习率进行交替训练呢?也就是自始至终都执行 其中,这样我们就把去掉了(当然引入了的选择,天下没免费午餐)。重复上述近似展开,我们就得到 (滑动查看完整公式) 这就相当于自始至终都在用学习率来优化损失函数了,也就是说一开始就把梯度惩罚给加了进去。这样能提升模型的泛化性能吗?笔者简单试了一下,有些情况下会有轻微的提升,基本上都不会有负面影响,总的来说不如自己直接加梯度惩罚好,所以不建议这样做。 本文简单介绍了ICML2020一篇论文提出的“到一定程度后就梯度上升”的训练策略,并给出了自己的推导和理解,结果显示它相当于对参数的梯度惩罚,而梯度惩罚也是常见的正则化手段之一。

思路描述

效果

个人分析

方法局限性

继续脑洞

文章小结

本文为原创文章,版权归知行编程网所有,欢迎分享本文,转载请保留出处!

内容反馈