作者:mingo_敏

编辑:深度学习自然语言处理小编zenRRan

链接:

https://blog.csdn.net/shanglianlm/article/details/85019768

tensorflow和pytorch很多都是相似的,这里以pytorch为例。

1. L1范数损失 L1Loss

reduction-三个值,none: 不使用约简;mean:返回loss和的平均值;sum:返回loss的和。默认:mean。

reduction-三个值,none: 不使用约简;mean:返回loss和的平均值;sum:返回loss的和。默认:mean。

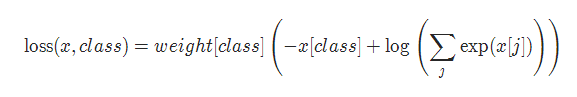

weight (Tensor, optional) – 自定义的每个类别的权重. 必须是一个长度为 C 的 Tensor ignore_index (int, optional) – 设置一个目标值, 该目标值会被忽略, 从而不会影响到 输入的梯度。 reduction-三个值,none: 不使用约简;mean:返回loss和的平均值;sum:返回loss的和。默认:mean。

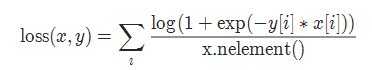

reduction-三个值,none: 不使用约简;mean:返回loss和的平均值;sum:返回loss的和。默认:mean。

weight (Tensor, optional) – 自定义的每个 batch 元素的 loss 的权重. 必须是一个长度为 “nbatch” 的 的 Tensor

weight (Tensor, optional) – 自定义的每个 batch 元素的 loss 的权重. 必须是一个长度 为 “nbatch” 的 Tensor

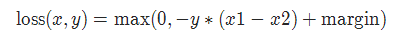

7 MarginRankingLoss

参数:

margin:默认值0

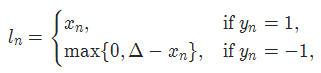

8 HingeEmbeddingLoss

参数:

margin:默认值1

9 多标签分类损失 MultiLabelMarginLoss

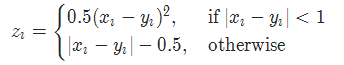

10 平滑版L1损失 SmoothL1Loss

其中

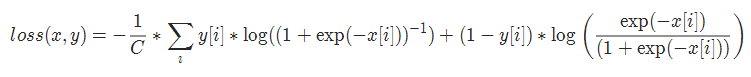

11 2分类的logistic损失 SoftMarginLoss

12 多标签 one-versus-all 损失 MultiLabelSoftMarginLoss

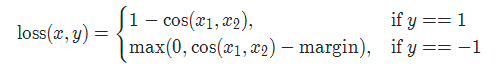

13 cosine 损失 CosineEmbeddingLoss

参数:

margin:默认值0

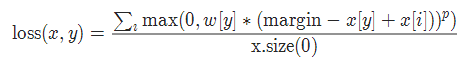

14 多类别分类的hinge损失 MultiMarginLoss

参数:

p=1或者2 默认值:1

margin:默认值1

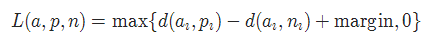

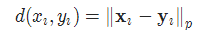

15 三元组损失 TripletMarginLoss

其中:

reduction-三个值,none: 不使用约简;mean:返回loss和的平均值;sum:返回loss的和。默认:mean。

weight (Tensor, optional) – 自定义的每个类别的权重. 必须是一个长度为 C 的 Tensor ignore_index (int, optional) – 设置一个目标值, 该目标值会被忽略, 从而不会影响到 输入的梯度.

weight (Tensor, optional) – 自定义的每个类别的权重. 必须是一个长度为 C 的 Tensor reduction-三个值,none: 不使用约简;mean:返回loss和的平均值;sum:返回loss的和。默认:mean。

log_input (bool, optional) – 如果设置为 True , loss 将会按照公 式 exp(input) - target * input 来计算, 如果设置为 False , loss 将会按照 input - target * log(input+eps) 计算. full (bool, optional) – 是否计算全部的 loss, i. e. 加上 Stirling 近似项 target * log(target) - target + 0.5 * log(2 * pi * target). eps (float, optional) – 默认值: 1e-8

为您推荐

本篇文章来源于: 深度学习这件小事

本文为原创文章,版权归知行编程网所有,欢迎分享本文,转载请保留出处!

内容反馈