来自 | 知乎 作者 | ALme

地址:https://zhuanlan.zhihu.com/p/113701629

编辑 | 深度学习这件小事

来抽象表达:

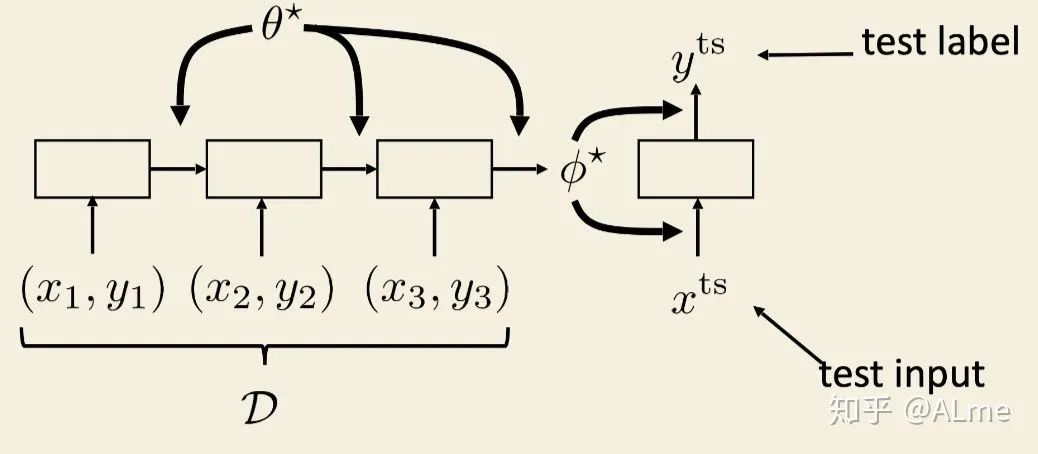

来抽象表达: 作用在训练集上,得到学习完毕后的模型

作用在训练集上,得到学习完毕后的模型  是从

是从  代表了完整的梯度下降过程。此时有一个初始网络

代表了完整的梯度下降过程。此时有一个初始网络  :

:

。

。 。并且得到了梯度下降算法所对应的“学习过程”

。并且得到了梯度下降算法所对应的“学习过程”  。这样的

。这样的 实际上是有缺点的。

实际上是有缺点的。 上动脑筋,看看能不能找到一个代替梯度下降的

上动脑筋,看看能不能找到一个代替梯度下降的 。

。 的替代品一般是不可行的,这就如同瞎猫撞死耗子。

的替代品一般是不可行的,这就如同瞎猫撞死耗子。 。

。 是“学习过程”的抽象,那么学习

是“学习过程”的抽象,那么学习  ,就是“学习如何学习”!听着好耳熟是不是,对,这就是元学习的思想。

,就是“学习如何学习”!听着好耳熟是不是,对,这就是元学习的思想。 ,是一个从数据集

,是一个从数据集  呢?学习

呢?学习  ,就要将一个个数据集

,就要将一个个数据集  中,再以某指标更新

中,再以某指标更新  。那么指标是什么呢?

。那么指标是什么呢? ,是能通过作用在训练集

,是能通过作用在训练集  。而如果将

。而如果将  作用在每个数据集的训练集

作用在每个数据集的训练集  得到的

得到的  的指标

的指标  也有自己的参数

也有自己的参数  的过程。而一旦

的过程。而一旦  学习完毕,便能够在一个数据集上快速地通过已学习的

学习完毕,便能够在一个数据集上快速地通过已学习的  学习出模型

学习出模型  的泛化能力。也就是说,这个抽象的“学习过程”应该能够在普遍的数据集上都能学到泛化能力强的模型。

的泛化能力。也就是说,这个抽象的“学习过程”应该能够在普遍的数据集上都能学到泛化能力强的模型。 的性能。因此类似学习

的性能。因此类似学习  时也应把“元数据集”

时也应把“元数据集”  ,后者用

,后者用

所在的函数范围来解决。

所在的函数范围来解决。 的输出结果不仅仅由训练集决定了, 现在是训练集与参数

的输出结果不仅仅由训练集决定了, 现在是训练集与参数  得到的

得到的 中,使得最后得到的是不会导致过拟合的学习方法

中,使得最后得到的是不会导致过拟合的学习方法  。

。<pre style="max-width: 100%;box-sizing: border-box !important;overflow-wrap: break-word !important;"><p style="max-width: 100%;min-height: 1em;letter-spacing: 0.544px;white-space: normal;color: rgb(0, 0, 0);font-family: -apple-system-font, system-ui, "Helvetica Neue", "PingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;widows: 1;line-height: 1.75em;box-sizing: border-box !important;overflow-wrap: break-word !important;"><strong style="max-width: 100%;box-sizing: border-box !important;overflow-wrap: break-word !important;"><span style="max-width: 100%;letter-spacing: 0.5px;font-size: 14px;box-sizing: border-box !important;overflow-wrap: break-word !important;"><strong style="max-width: 100%;font-size: 16px;letter-spacing: 0.544px;box-sizing: border-box !important;overflow-wrap: break-word !important;"><span style="max-width: 100%;letter-spacing: 0.5px;box-sizing: border-box !important;overflow-wrap: break-word !important;">—</span></strong>完<strong style="max-width: 100%;font-size: 16px;letter-spacing: 0.544px;box-sizing: border-box !important;overflow-wrap: break-word !important;"><span style="max-width: 100%;letter-spacing: 0.5px;font-size: 14px;box-sizing: border-box !important;overflow-wrap: break-word !important;"><strong style="max-width: 100%;font-size: 16px;letter-spacing: 0.544px;box-sizing: border-box !important;overflow-wrap: break-word !important;"><span style="max-width: 100%;letter-spacing: 0.5px;box-sizing: border-box !important;overflow-wrap: break-word !important;">—</span></strong></span></strong></span></strong></p><section style="max-width: 100%;letter-spacing: 0.544px;white-space: normal;font-family: -apple-system-font, system-ui, "Helvetica Neue", "PingFang SC", "Hiragino Sans GB", "Microsoft YaHei UI", "Microsoft YaHei", Arial, sans-serif;widows: 1;box-sizing: border-box !important;overflow-wrap: break-word !important;"><section powered-by="xiumi.us" style="max-width: 100%;box-sizing: border-box !important;overflow-wrap: break-word !important;"><section style="margin-top: 15px;margin-bottom: 25px;max-width: 100%;opacity: 0.8;box-sizing: border-box !important;overflow-wrap: break-word !important;"><section style="max-width: 100%;box-sizing: border-box !important;overflow-wrap: break-word !important;"><section style="max-width: 100%;letter-spacing: 0.544px;box-sizing: border-box !important;overflow-wrap: break-word !important;"><section powered-by="xiumi.us" style="max-width: 100%;box-sizing: border-box !important;overflow-wrap: break-word !important;"><section style="margin-top: 15px;margin-bottom: 25px;max-width: 100%;opacity: 0.8;box-sizing: border-box !important;overflow-wrap: break-word !important;"><section style="max-width: 100%;box-sizing: border-box !important;overflow-wrap: break-word !important;"><p style="margin-bottom: 15px;padding-right: 0em;padding-left: 0em;max-width: 100%;min-height: 1em;color: rgb(127, 127, 127);font-size: 12px;font-family: sans-serif;line-height: 25.5938px;letter-spacing: 3px;box-sizing: border-box !important;overflow-wrap: break-word !important;"><span style="max-width: 100%;color: rgb(0, 0, 0);box-sizing: border-box !important;overflow-wrap: break-word !important;"><strong style="max-width: 100%;box-sizing: border-box !important;overflow-wrap: break-word !important;"><span style="max-width: 100%;font-size: 16px;font-family: 微软雅黑;caret-color: red;box-sizing: border-box !important;overflow-wrap: break-word !important;">为您推荐</span></strong></span></p><p style="margin-top: 5px;margin-bottom: 5px;padding-right: 0em;padding-left: 0em;max-width: 100%;min-height: 1em;font-family: sans-serif;letter-spacing: 0px;opacity: 0.8;line-height: normal;box-sizing: border-box !important;overflow-wrap: break-word !important;">一个AI PhD的毕业随感<br style="max-width: 100%;box-sizing: border-box !important;overflow-wrap: break-word !important;" /></p><p style="margin-top: 5px;margin-bottom: 5px;padding-right: 0em;padding-left: 0em;max-width: 100%;min-height: 1em;font-family: sans-serif;letter-spacing: 0px;opacity: 0.8;line-height: normal;box-sizing: border-box !important;overflow-wrap: break-word !important;"><span style="max-width: 100%;color: rgb(87, 107, 149);font-size: 14px;box-sizing: border-box !important;overflow-wrap: break-word !important;">MIT最新深度学习入门课,安排起来!</span></p><p style="margin-top: 5px;margin-bottom: 5px;padding-right: 0em;padding-left: 0em;max-width: 100%;min-height: 1em;font-family: sans-serif;letter-spacing: 0px;opacity: 0.8;line-height: normal;box-sizing: border-box !important;overflow-wrap: break-word !important;"><span style="max-width: 100%;color: rgb(87, 107, 149);font-size: 14px;box-sizing: border-box !important;overflow-wrap: break-word !important;">有了这个神器,轻松用 Python 写个 App</span></p><p style="margin-top: 5px;margin-bottom: 5px;padding-right: 0em;padding-left: 0em;max-width: 100%;min-height: 1em;font-family: sans-serif;letter-spacing: 0px;opacity: 0.8;line-height: normal;box-sizing: border-box !important;overflow-wrap: break-word !important;"><span style="max-width: 100%;color: rgb(87, 107, 149);font-size: 14px;box-sizing: border-box !important;overflow-wrap: break-word !important;">「最全」实至名归,NumPy 官方早有中文教程</span></p><section style="margin: 5px 16px;padding-right: 0em;padding-left: 0em;max-width: 100%;min-height: 1em;font-family: sans-serif;letter-spacing: 0px;opacity: 0.8;line-height: normal;box-sizing: border-box !important;overflow-wrap: break-word !important;"><span style="font-size: 14px;">北大团队成功实现精准删除特定记忆,马斯克脑机接口有望今年人体测试</span><br /></section></section></section></section></section></section></section></section></section>

本篇文章来源于: 深度学习这件小事

本文为原创文章,版权归知行编程网所有,欢迎分享本文,转载请保留出处!

内容反馈