今天来跟大家分享一下,基于Scrapy的微博爬虫应该怎么写。

01

Scrapy简介

首先,我们需要对Scrapy框架有一个简单的了解,不然在你书写代码的时候会非常的麻烦。

01

安装

使用pip对Scrapy进行安装,代码如下:

pip install scrapy

02

创建项目

安装好Scrapy框架之后,我们需要通过终端,来创建一个Scrapy项目,命令如下:

scrapy startproject weibo

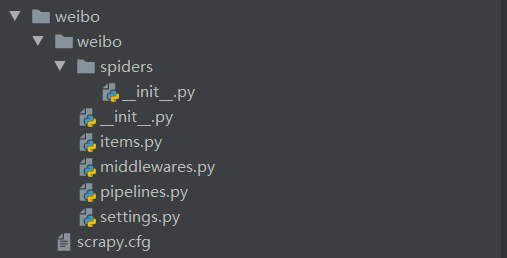

创建好后的项目结构,如下图:

这里我们来简单介绍一下结构中我们用到的部分的作用,有助于我们后面书写代码。

spiders是存放爬虫程序的文件夹,将写好的爬虫程序放到该文件夹中。items用来定义数据,类似于字典的功能。settings是设置文件,包含爬虫项目的设置信息。pipelines用来对items中的数据进行进一步处理,如:清洗、存储等。

02

数据采集

经过上面的简单介绍,我们现在对Scrapy框架有了简单的了解,下面我们开始写数据采集部分的代码。

01

定义数据

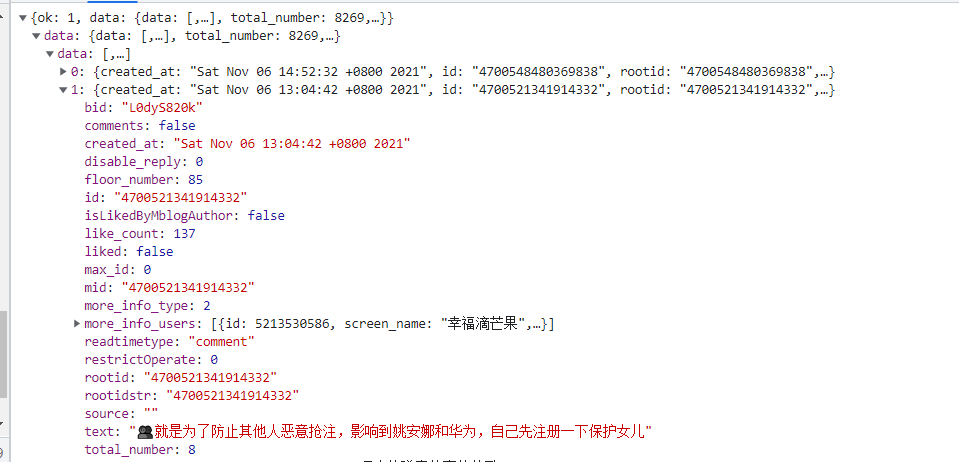

首先,我们对数据存储的网页进行观察,方便我们对获取数据进行定义

通过对网页中数据存储的形式进行观察后,items.py中对数据的定义方式为:

data = scrapy.Field()

02

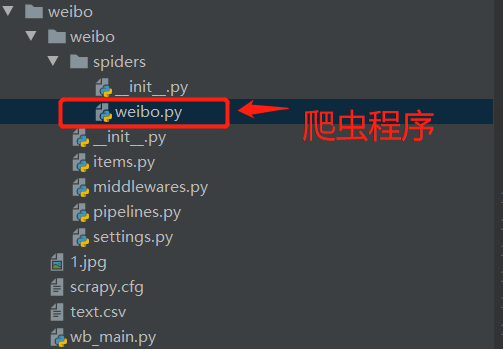

编辑爬虫

接下来我们在spiders文件夹里面创建一个weibo.py爬虫程序用以书写请求的爬虫代码

代码如下:

03

遍历爬取

学过Requests对微博评论进行爬虫的朋友应该知道,微博评论的URL构造方式,这里我直接展示构造代码:

02

数据存储

光爬取下来数据是不行的,我们还需要对数据进行存储,这里我采用的是csv文件,来对评论数据进行存储,代码如下:

])

self.exporter.start_exporting()

03

程序配置

光写上面的代码是无法爬取到评论的,因为我们还没有对整个程序进行有效的配置,下面我们就在settings.py里面进行配置。

01

不遵循robots协议

需要对robts协议的遵守进行修改,如果我们遵循网页的robots协议的话,那无法进行爬取,代码如下:

02

使用自定义cookie

我们知道,想要爬取微博评论,需要带上自己的cookie用以信息校验,因为我们的cookie是在headers中包裹着的,所以我们需要将COOKIES_ENABLED改为False,代码如下:

03

打开管道

想要进行数据存储,还需要在配置中,打开通道,用以数据传输,代码如下:

,

}

04

启动程序

我们在spiders同级的的目录下创建一个wb_main.py文件,便于我们在编辑器中启动程序,代码如下:

05

总结

本文详细的介绍了,如何用Scrapy框架来对微博评论进行爬取,建议大家动手实操一下,便于理解。本文仅供学习参考,不做它用。

本文为原创文章,版权归知行编程网所有,欢迎分享本文,转载请保留出处!

内容反馈