经常有读者会爬虫学哪个库?其实常用的 Python 爬虫库无非是requests,selenium和scrapy,且每个库都有他们的特点,对于我来说没有最推荐的库只有最合适库,本文就将基于一个简单的爬虫案例(Python爬取起点中文网)来对比分析(从时间角度)三个库

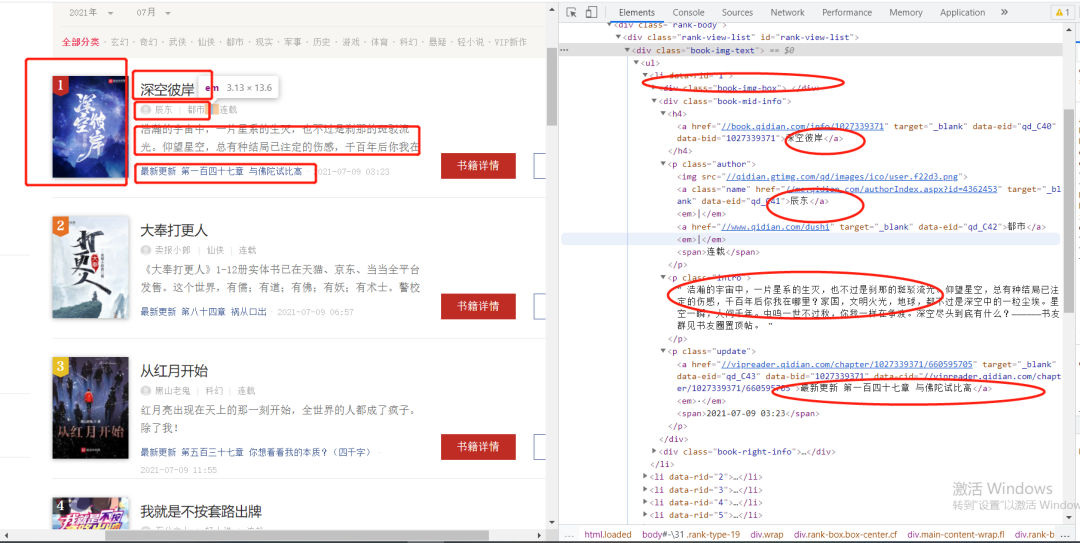

页面结构很容易分析出来,排行榜100条书籍信息,一个静态页面包含20条数据。使用不同的第三方库进行数据解析并提取数据,分别是:

-

requests -

selenium -

Scrapy

然后再逻辑代码的开头和结尾加上时间戳,得到程序运行时间,进行效率对比。

这里由于都是使用xpath提取数据,三种方式xpath语句大同小异,这里提前数据解析说明:

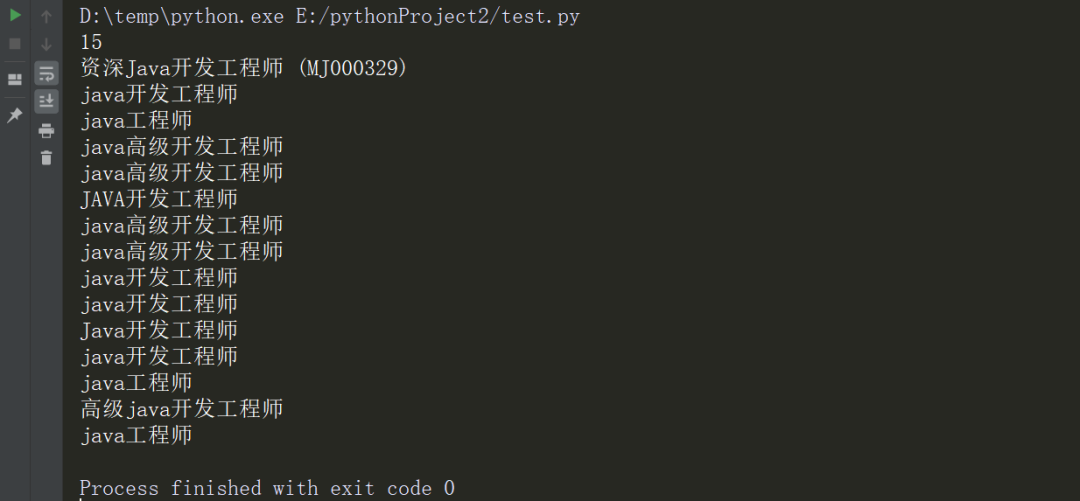

webdriverurl = 'https://www.lagou.com/zhaopin/Java/?labelWords=label'

driver = webdriver.Chrome()

driver.get(url)

items = driver.find_elements_by_xpath("//ul[@class='item_con_list']/li")

print(len(items))

for item in items:

title = item.find_element_by_xpath("./div[1]/div[1]/div[1]/a/h3").text

print(title)

很轻松就提取到了页面的数据!

所以根据本文的案例分析,如果有爬虫需求时,将方法定格在某一个方法并非是一个很好的选择,大多情况下我们需要根据对应网站/app的特点以及具体需求,来综合判断,挑选出最合适的爬虫库!

本文为原创文章,版权归知行编程网所有,欢迎分享本文,转载请保留出处!

内容反馈